Jak na manipulace s informacemi v éře AI s Dominikem Voráčem

Jak se dá manipulovat s informacemi v době generativní umělé inteligence? A jak se s nimi manipulovalo dříve? A je v tom velký rozdíl? Potřebujeme nové know-how, abychom si zachovali kritický přístup k informacím? Jak jednoduše odhalit manipulaci v mediálním obsahu? A může nám v tomto umělá inteligence nějak pomoct? A jaká by měla být role vzdělavatelů v éře AI, pokud jde o obranu proti manipulaci?

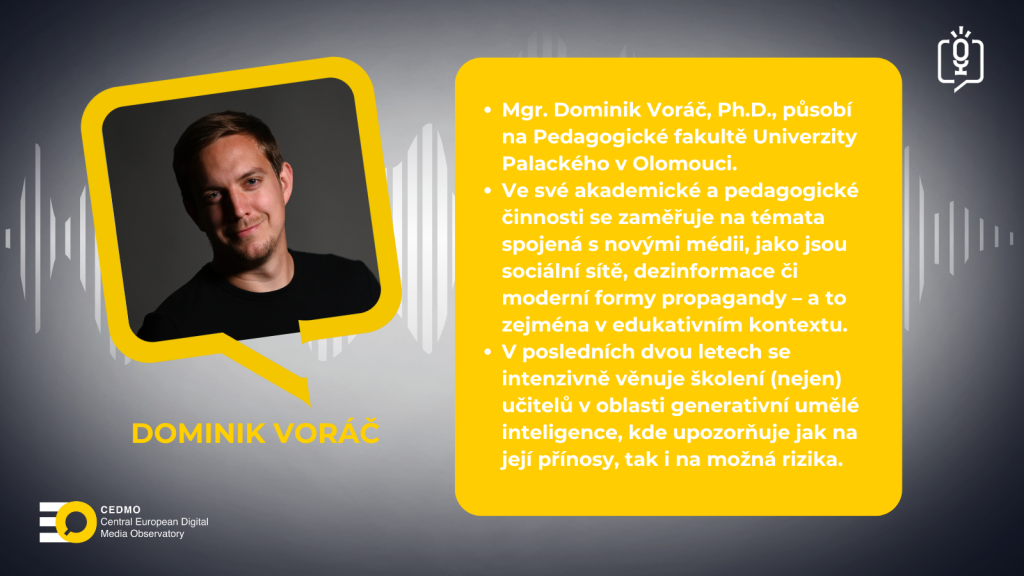

V sedmém díle podcastové série Mediální minimum si Lucie Šťastná povídá s Dominikem Voráčem, pedagogem a výzkumníkem z Pedagogické fakulty Univerzity Palackého v Olomouci, který se zaměřuje na témata spojená s novými médii, jako jsou sociální sítě, dezinformace, moderní formy propagandy nebo přínosy a rizika generativní umělé inteligence, a to zejména v edukativním kontextu.

Poslechněte si tuto epizodu Mediálního minima na Spotify, Apple Podcasts, Podcast Addict, Buzzsprout, Podcast Index nebo platformě Podchaser. Pokud vás zajímá už teď, co například se v nové epizodě dozvíte, čtěte dál.

Základem manipulace s informacemi je zkreslení

Na úvod rozhovoru Dominik Voráč vysvětlil, co všechno se dá považovat za manipulaci s informacemi a že je třeba si uvědomovat i to, proč k ní dochází. Před rozšířením nástrojů generativní umělé inteligence se manipulovalo s informacemi například pomocí clickbaitů, které lákaly uživatele senzačními titulky ke kliknutí na článek, nebo pomocí argumentačních faulů. Z těch vysvětlil například nakloněnou rovinu, falešné dilema nebo cherry picking.

Pokud se zaměříme na manipulaci s obrazem, tak se v minulosti často starší fotografie využívala v novém kontextu. „Typicky fotografie třeba z 90. let, jak tuším albánští uprchlíci, jsou na velké lodi a jich tam opravdu spousta, tak ta se použila pak v roce 2015, když tady byla imigrační krize se slovy: Už tady jdou hordy migrantů a obsadí naše země a tak dále,“ vysvětlil Dominik Voráč.

U videí zase bylo (a stále je) typické vytrhávání určitých výroků z kontextu, zejména na sociálních sítích. „Já si vystřihnu třeba z nějakého rozhovoru 20 sekund mé nějaké reakce na mého oponenta a už tam nedám tu reakci toho oponenta. A napíšu tam třeba komentář: Vidíte, jak se mu to nandal. Ale vlastně já vůbec nedávám prostor té druhé straně, tomu protinázoru, tudíž ten divák si nemůže vůbec udělat obraz o celé té problematice.“

AI všechno zrychlila a zjednodušila

Největším rozdílem, který přinesly nástroje generativní umělé inteligence do oblasti manipulace s informacemi, je podle Dominika Voráče rychlost, s jakou se dají zavádějící obsahy vytvářet. Manipulativní texty i obrázky pomůže vytvořit umělá inteligence během pár minut, zatímco dříve to trvalo hodiny. I když Chat GPT upozorní na to, že dezinformační texty tvořit nemůže, dá se to podle Dominika Voráče obejít dalšími prompty (příkazy).

I vytvoření manipulativního videa je podle něj mnohem jednodušší než dříve, například na platformě Kyber. „My si to video můžeme vytvořit i z falešného obrázku, který si vytvoříme zase třeba ať už v tom Chatu GPT anebo v Mid Journey anebo v dalších generátorech obrázků.“ K vytvoření klonovaného hlasu zase poslouží nástroj Eleven Labs, kam stačí vložit minutovou nahrávku hlasu, který chceme naklonovat, a vznikne audio, které nikdo nikdy neřekl.

Neustálé zdokonalování AI nástrojů znemožňuje jednoduše rozpoznat manipulaci

Stále těžké je ale pro umělou inteligenci synchronizovat vytvořené audio s vygenerovaným videem, ačkoliv se i toto neustále zlepšuje a posouvá, stále se dá poznat, že pohyby rtů neodpovídají řečenému. Ale samozřejmě to není tak jednoduché pro každého z nás.

Velký problém spojený s deep fake videi vidí Dominik Voráč v jejich zneužívání k finančním podvodům, které cílí právě na méně digitálně gramotné uživatele. Na tento problém upozornila i Jana Magdoňová v předchozím díle Mediálního minima o ověřování informací.

Dominik Voráč jako příklad uvedl video, kde „mluví třeba Petr Pavel o tom, že tady můžou občané České republiky investovat do tohoto a tohoto fondu a že budou mít třeba 15 000 měsíčně.“ Pro poučeného uživatele není těžké poznat, že jde o video vytvořené AI, těžší už to ale může být pro někoho, kdo má horší zrak nebo sleduje video na malém zařízení, nemá plynulý internet, nebo pro seniory. „A to nejsou třeba tisíce, ale jsou případy, kdy třeba někdo takhle utratí v uvozovkách, anebo ztratí milion a půl, dva miliony, a ještě k tomu všemu si na to půjčí,“ vysvětlil Voráč.

Být kritický a obezřetný a vzdělávat se

„Čím dál těžší je v té změti těch informací si najít to, čemu mám důvěřovat a čemu ne,“ uznal Voráč. Právě proto je důležité rozvíjet mediální výchovu, což se podle něj ze strany státu v posledních letech příliš neděje (jako příklad uvedl nově schválené Rámcové vzdělávací programy, ve kterých je prostor pro mediální výchovu menší než dříve).

Ale co můžeme udělat sami proto, abychom informacím kolem nás porozuměli a zachovali si kritický odstup? Podle Dominika Voráče je důležité hlavně „se z toho nezbláznit“ a „nevěřit úplně všemu“.

Kritičtí a obezřetní bychom měli být i vůči generativní umělé inteligenci a informacím, které nám dodává. „Já si myslím, že to je naprosto skvělý nástroj, který má ale nějaká omezení. Ta omezení plynou z toho, že to vždycky vychází z dat, které v tom nástroji jsou. I když to množství dat je obrovské, tak samozřejmě u nějakých specializovaných věcí ta data chybí. No a co teda ten Chat GPT anebo jakýkoliv nástroj nikdy neudělá, tak je to, že by hned napsalo, že něco neví, nebo že to neví s jistotou.“ Pak může uvést nesprávné informace, které si dotvoří podle sebe. Proto je důležité vědět, jak generativní umělá inteligence funguje, jaké jsou její limity a na co je naopak dobré ji použít.

Podle Voráče se dá s generativní umělou inteligencí naučit svépomocí, ale i dalších vzdělávacích příležitostí je teď podle něj v této oblasti dost. „Umělá inteligence je tak velké téma, že se mi zdá, že se toho všichni chopili a opravdu se školí hodně. Je hodně přednášek o tom. Je hodně edukačních videí.“ Dominik Voráč ale také upozornil na to, že s vlnou zájmu o AI ve vzdělávání se objevily i rozdíly v kvalitě mezi vzdělavateli, a proto vybízí přistupovat i k informacím od vzdělavatelů o AI kriticky a zkoušet se naučit se s ní zároveň i samostatně. „Dokonce i se můžu i té umělé inteligence zeptat, co sama umí, nebo co můžu za pomoci AI udělat, a ona taky třeba podá nějakou radu.“

Vzdělavatelé by neměli podle Voráče AI ani příliš glorifikovat, ani před ní příliš strašit, ale představovat ho jako nástroj, který má své přínosy i rizika.

Na co AI třeba využít?

Dominik Voráč doporučil využít Chat GPT pro vytvoření vlastního názoru na určitý problém. „Nastíníte ten problém a zeptáte se, (…) jaké jsou argumenty pro a proti to dělat. No a i když teda nikdy nebude žádný nástroj umělé inteligence naprosto objektivní, protože záleží na těch datech, tak v těchto věcech se opravdu snaží objektivní být a ukázat těch pět pro a pět proti. A já tím pádem už mám všechny ty informace, které potřebuju, abych si na to udělal informovaný názor.“

Voráč také doporučuje funkci Chatu GPT, která umožňuje prohledat web a poskytnout zdroje, ze kterých čerpal. Problém však může být, pokud nemáme placenou verzi, kde je tato funkce stále ještě dost omezena (jen do vypršení limitu). A použít se to dá hlavně v případě internetových odkazů – pokud Chat GPT uvede, že čerpá z nějaké knihy, je velmi těžké a zdlouhavé to ověřit. Používat Chat GPT vyloženě k rešerši a hledání zdrojů ale podle něj (zatím) vhodné není, doporučil by starý osvědčený Google.

Další oblastí, ve které může generativní umělá inteligence dobře posloužit, jsou nápady a inspirace. „Tam si myslím, že v tomto je to úplně skvělé, protože nemusíte znát tu přesnou nějakou odpověď, ale nápady a inspirace jsou jenom o tom, že vás třeba něco nenapadne a pomocí toho chatu GPT vás to napadne,“ vysvětlil Dominik Voráč.

Umělá inteligence by mohla dokonce sama pomoct odhalovat manipulativní texty, obrázky či videa vytvořená pomocí umělé inteligence. Zmínil příklad takového nástroje, který vyvíjejí vědci na Univerzitě Palackého v Olomouci, ale zároveň vyjádřil obavy, že tvorba „fejků“ bude vždy rychlejší než jejich odhalování.

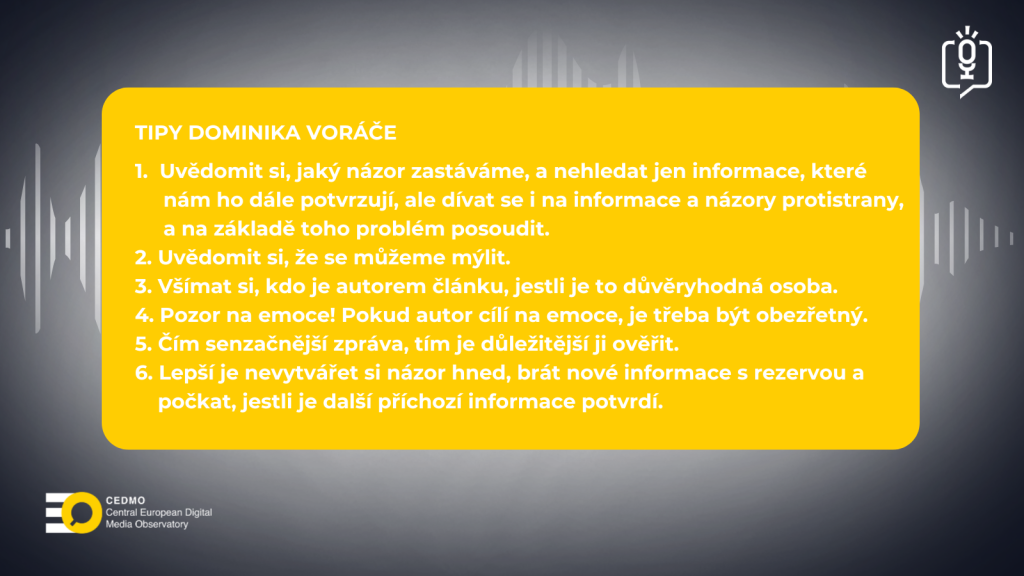

Na závěr Dominik Voráč uvedl tipy, jak být v digitálním prostoru vnímavější a manipulaci s informacemi rozpoznat.

Zdroje k rozhovoru:

Argumentační klam. Wikipedie: otevřená encyklopedie [online]. [cit. 2. května 2025]. Dostupné z: https://cs.wikipedia.org/wiki/Argumenta%C4%8Dn%C3%AD_klam

Deep fake. YouTube [online]. 2024-01-09 [cit. 2. května 2025]. Dostupné z: https://www.youtube.com/watch?v=N9cTood6uw0

KOPECKÝ, Kamil, SZOTKOWSKI, René a Lukáš KUBALA. Rizika spojená s umělou inteligencí pro seniory. Pedagogická fakulta Univerzity Palackého v Olomouci, 2024. Dostupné také z: https://belux-edmo.s3-accelerate.amazonaws.com/2024/05/Rizika-AI-pro-Seniory.pdf

KOPECKÝ, Kamil, VORÁČ, Dominik, SZOTKOWSKI, René. Na pravdě záleží. Příručka pro učitele, jak učit o pravdě a lži na internetu. Pedagogická fakulta Univerzity Palackého v Olomouci, 2023. Dostupné také z: https://cedmohub.eu/wp-content/uploads/2023/03/Pravda-a-lez_final_web_po-stranach_webova-kvalita_new-30.-3.pdf

KOPECKÝ, Kamil. Generativní umělá inteligence výrazně mění náš pohled na informace. Čemu budeme věřit? A jak ovlivní např. volby? E-bezpečí.cz[online]. 2024-03-06 [cit. 2. května 2025]. Dostupné z: https://www.e-bezpeci.cz/index.php/rizikove-jevy-spojene-s-online-komunikaci/socialni-site/3884-generativni-umela-inteligence-vyrazne-meni-nas-pohled-na-informace-cemu-budeme-verit-a-jak-ovlivni-napr-volby

Mediální výchova pro 21. století. Mv21.cz [online]. [cit. 2. května 2025]. Dostupné z: https://www.mv21.cz/blog

NUTIL, Petr. Média, lži a příliš rychlý mozek. Praha: Grada, 2018.

TOMANOVÁ, Lucie. Podrobný návod na ChatGPT: Využijte umělou inteligenci na maximum. Seznamzpravy.cz [online]. 2024-08-31 [cit. 2. května 2025]. Dostupné z: https://www.seznamzpravy.cz/clanek/tech-chatgpt-ai-navod-258510

Vyzobávání rozinek. Wikipedie: otevřená encyklopedie [online]. [cit. 2. května 2025]. Dostupné z: https://cs.wikipedia.org/wiki/Vyzob%C3%A1v%C3%A1n%C3%AD_rozinek

Tipy ke čtení

TOMANOVÁ, Lucie. Podrobný návod na ChatGPT: Využijte umělou inteligenci na maximum. Seznamzpravy.cz [online]. 2024-08-31 [cit. 2. května 2025]. Dostupné z: https://www.seznamzpravy.cz/clanek/tech-chatgpt-ai-navod-258510

Argumentační fauly. Bezfaulu.net [online]. [cit. 2. května 2025]. Dostupné z: https://bezfaulu.net/argumentacni-fauly/

TULINSKÁ, Hana. Kurz práce s informacemi: Manipulace informací a dezinformace. Kisk.phil.muni.cz [online]. [cit. 2. května 2025]. Dostupné z: https://kisk.phil.muni.cz/media/3219955/kisk.phil.muni.cz/kpi/hodnoceni-kvality-informaci/manipulace-informaci-a-dezinformace.html

Fotomontáže, koláže, upravené fotografie, posuny kontextu. E-bezpečí. [online]. [cit. 2. května 2025]. Dostupné z: https://www.e-bezpeci.cz/index.php/priklady/fotografie

Poznáš pravdu od lži? Otestuj se. E-bezpečí. [online]. [cit. 2. května 2025]. Dostupné z: https://www.e-bezpeci.cz/hoaxy/

Tipy ke zhlédnutí

Vzdělávací videa ze série „Abeceda médií“ od E-bezpečí – Abeceda médií. E-bezpečí. [online]. [cit. 2. května 2025]. Dostupné z: https://www.e-bezpeci.cz/index.php/pravda-a-lez-v-online-svete/70-projekt-fake-news/2790-abeceda-medii

KOPECKÝ, Kamil. Kognitivní zkreslení. YouTube [online]. 2023-12-23 [cit. 2. května 2025]. Dostupné z: https://www.youtube.com/watch?v=wv2I_dM_jUk

KOPECKÝ, Kamil. Deep fake. YouTube [online]. 2024-01-09 [cit. 2. května 2025]. Dostupné z: https://www.youtube.com/watch?v=N9cTood6uw0

Tipy k poslechu

Rozpravy 2025/05 na téma „AI v médiích“, kde se dozvíte, jak se používá AI v českých médiích a jakým výzvám v této souvislosti česká média a novináři čelí – vyjdou 9. 5. na vašich oblíbených podcastových platformách.

Podcast ČVUT Jedničky a Nuly, např. epizoda „Nevěřte všemu, co vidíte – aneb co to znamená vizualizace dat?“ nebo epizoda „Co je nového ve světě AI?“ – Podcast Jedničky a nuly. Fit.cvut.cz [online]. [cit. 2. května 2025]. Dostupné z: https://fit.cvut.cz/cs/zivot-na-fit/aktualne/podcast